N'utilisez pas de boucles spécialement à cette échelle dans RDBMS.

Essayez de remplir rapidement votre tableau avec 1 million de lignes avec une requête

INSERT INTO `entity_versionable` (fk_entity, str1, str2, bool1, double1, date)

SELECT 1, 'a1', 100, 1, 500000, '2013-06-14 12:40:45'

FROM

(

select a.N + b.N * 10 + c.N * 100 + d.N * 1000 + e.N * 10000 + f.N * 100000 + 1 N

from (select 0 as N union all select 1 union all select 2 union all select 3 union all select 4 union all select 5 union all select 6 union all select 7 union all select 8 union all select 9) a

, (select 0 as N union all select 1 union all select 2 union all select 3 union all select 4 union all select 5 union all select 6 union all select 7 union all select 8 union all select 9) b

, (select 0 as N union all select 1 union all select 2 union all select 3 union all select 4 union all select 5 union all select 6 union all select 7 union all select 8 union all select 9) c

, (select 0 as N union all select 1 union all select 2 union all select 3 union all select 4 union all select 5 union all select 6 union all select 7 union all select 8 union all select 9) d

, (select 0 as N union all select 1 union all select 2 union all select 3 union all select 4 union all select 5 union all select 6 union all select 7 union all select 8 union all select 9) e

, (select 0 as N union all select 1 union all select 2 union all select 3 union all select 4 union all select 5 union all select 6 union all select 7 union all select 8 union all select 9) f

) t

Il a fallu environ 8 secondes pour ma boîte (MacBook Pro 16 Go de RAM, 2,6 Ghz d'Intel Core i7)

Query OK, 1000000 rows affected (7.63 sec) Records: 1000000 Duplicates: 0 Warnings: 0

MISE À JOUR1 Maintenant une version d'une procédure stockée qui utilise une instruction préparée

DELIMITER $$

CREATE PROCEDURE `inputRowsNoRandom`(IN NumRows INT)

BEGIN

DECLARE i INT DEFAULT 0;

PREPARE stmt

FROM 'INSERT INTO `entity_versionable` (fk_entity, str1, str2, bool1, double1, date)

VALUES(?, ?, ?, ?, ?, ?)';

SET @v1 = 1, @v2 = 'a1', @v3 = 100, @v4 = 1, @v5 = 500000, @v6 = '2013-06-14 12:40:45';

WHILE i < NumRows DO

EXECUTE stmt USING @v1, @v2, @v3, @v4, @v5, @v6;

SET i = i + 1;

END WHILE;

DEALLOCATE PREPARE stmt;

END$$

DELIMITER ;

Terminé en ~3 minutes :

mysql> CALL inputRowsNoRandom(1000000); Query OK, 0 rows affected (2 min 51.57 sec)

Ressentez la différence entre 8 secondes et 3 minutes

MISE À JOUR2 Pour accélérer les choses, nous pouvons utiliser explicitement les transactions et valider les insertions par lots. Alors voilà une version améliorée du SP.

DELIMITER $$

CREATE PROCEDURE inputRowsNoRandom1(IN NumRows BIGINT, IN BatchSize INT)

BEGIN

DECLARE i INT DEFAULT 0;

PREPARE stmt

FROM 'INSERT INTO `entity_versionable` (fk_entity, str1, str2, bool1, double1, date)

VALUES(?, ?, ?, ?, ?, ?)';

SET @v1 = 1, @v2 = 'a1', @v3 = 100, @v4 = 1, @v5 = 500000, @v6 = '2013-06-14 12:40:45';

START TRANSACTION;

WHILE i < NumRows DO

EXECUTE stmt USING @v1, @v2, @v3, @v4, @v5, @v6;

SET i = i + 1;

IF i % BatchSize = 0 THEN

COMMIT;

START TRANSACTION;

END IF;

END WHILE;

COMMIT;

DEALLOCATE PREPARE stmt;

END$$

DELIMITER ;

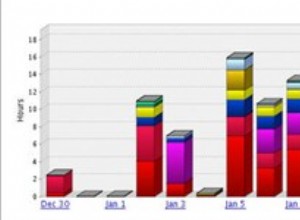

Résultats avec différentes tailles de lots :

mysql> CALL inputRowsNoRandom1(1000000,1000); Query OK, 0 rows affected (27.25 sec) mysql> CALL inputRowsNoRandom1(1000000,10000); Query OK, 0 rows affected (26.76 sec) mysql> CALL inputRowsNoRandom1(1000000,100000); Query OK, 0 rows affected (26.43 sec)

Vous voyez vous-même la différence . Toujours> 3 fois pire que la jointure croisée.