Vous pouvez gérer cela en inspectant les erreurs produites avec BulkWriteError . Il s'agit en fait d'un "objet" qui possède plusieurs propriétés. Les parties intéressantes sont dans details :

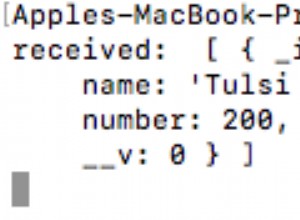

import pymongo

from bson.json_util import dumps

from pymongo import MongoClient

client = MongoClient()

db = client.test

collection = db.duptest

docs = [{ '_id': 1 }, { '_id': 1 },{ '_id': 2 }]

try:

result = collection.insert_many(docs,ordered=False)

except pymongo.errors.BulkWriteError as e:

print e.details['writeErrors']

Lors d'une première exécution, cela donnera la liste des erreurs sous e.details['writeErrors'] :

[

{

'index': 1,

'code': 11000,

'errmsg': u'E11000 duplicate key error collection: test.duptest index: _id_ dup key: { : 1 }',

'op': {'_id': 1}

}

]

Lors d'une deuxième exécution, trois erreurs s'affichent car tous les éléments existaient :

[

{

"index": 0,

"code": 11000,

"errmsg": "E11000 duplicate key error collection: test.duptest index: _id_ dup key: { : 1 }",

"op": {"_id": 1}

},

{

"index": 1,

"code": 11000,

"errmsg": "E11000 duplicate key error collection: test.duptest index: _id_ dup key: { : 1 }",

"op": {"_id": 1}

},

{

"index": 2,

"code": 11000,

"errmsg": "E11000 duplicate key error collection: test.duptest index: _id_ dup key: { : 2 }",

"op": {"_id": 2}

}

]

Il vous suffit donc de filtrer le tableau pour les entrées avec "code": 11000 et ensuite seulement "paniquer" quand quelque chose d'autre est là

panic = filter(lambda x: x['code'] != 11000, e.details['writeErrors'])

if len(panic) > 0:

print "really panic"

Cela vous donne un mécanisme pour ignorer les erreurs de clé en double, mais bien sûr en prêtant attention à quelque chose qui est en fait un problème.